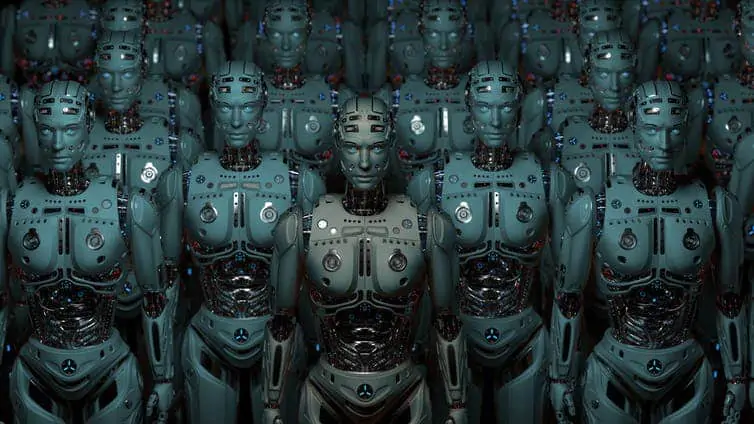

As guerras futuras serão mais rápidas e tecnológicas, mas menos humanas do que nunca: bem-vindos à era dos soldados-robôs.

Existe um lugar perfeito para testar armas avançadas: as Ilhas Wallops, um pequeno pedaço de terra na costa da Virgínia que parece ter vindo direto do reduto de Asimov. Se um barco de pesca tivesse passado por ali há um ano, teria visto meia dúzia de botes a circular na zona: um olhar mais atento teria revelado que os botes não tinham ninguém a bordo.

Os barcos utilizavam um motor que se ajustava de acordo com o contexto e transmitia ações e posições a todos os demais, organizando instantaneamente a frota de acordo com uma estratégia. Até disparando, talvez para defender as tropas estacionadas na costa.

O esforço semi-secreto, parte de um programa da Marinha dos EUA chamado Sea Mob, é uma maneira de deixar claro que as máquinas equipadas com inteligência artificial em breve serão perfeitamente capazes de mover até ataques letais sem nenhuma supervisão humana e desprezando leis de robótica.

Formulado por Isaac Asimov, um dos pais da ficção científica, as três leis da robótica foram publicados pela primeira vez em um conto de 1942. Em seus romances, o escritor russo-americano os menciona com frequência: são princípios rígidos, não devem ser transgredidos, teorizados para tranquilizar a humanidade sobre as boas "intenções" dos robôs.

Quem sabe se Asimov previu que as suas “leis” correriam o risco de desmoronar como está prestes a acontecer.

Morte automática

A ideia de enviar máquinas grandes, mortais e autônomas para a batalha não é nova: Sistemas semelhantes foram testados durante décadas, mesmo que de natureza defensiva, como aqueles que permitem a cobertura de mísseis hostis. O desenvolvimento da inteligência artificial permitirá a criação de sistemas ofensivos que não responderão simplesmente aos estímulos, mas decidirão por si próprios o que fazer, sem intervenção humana.

Um humano leva um quarto de segundo para reagir ao ver algo (imagine o tempo que um goleiro leva para decidir onde se atirar durante um pênalti). As máquinas que criamos já nos superam, pelo menos em velocidade. Este ano, por exemplo, pesquisadores da Universidade Tecnológica de Nanyang, em Cingapura, treinaram uma rede neural para absorver dados de 1.2 milhão de imagens. O computador tentou identificar os assuntos nas fotos e demorou 90 segundos. 0.000075 segundos por foto.

Por enquanto ainda há muito a fazer: nessa velocidade incrível o sistema identificou a pessoa da foto apenas em 58% dos casos. Uma taxa de sucesso que seria desastrosa em batalha. No entanto, o facto de as máquinas serem capazes de se mover muito mais rapidamente do que nós é um facto estabelecido e só irá aumentar. Na próxima década, a nova geração de mísseis viajará ao nível suborbital, demasiado rapidamente para que um homem possa decidir como combatê-los ou gerir a situação. Bandos de drones autônomos atacarão e outros computadores responderão em velocidade supersônica.

“Quando a guerra se torna tão rápida, em que ponto o ser humano se torna um obstáculo?” ele se pergunta Robert Trabalho, Vice-chefe do Pentágono com Obama e Trump. “Não temos como intervir, então vamos delegar nas máquinas.” Além de Asimov, em suma.

Armas que se fazem

Hoje em dia, todos os aspectos militares veem pesquisas comprometidas em garantir um tipo de guerra mais rápido, mais preciso e menos humano possível.

La marina A American testa um navio de 135 toneladas chamado Sea Hunter, que patrulha os oceanos sem tripulação, em busca de submarinos que um dia serão capazes de abater diretamente. Em um teste, o navio viajou 4000 km do Havaí para a Califórnia sem intervenção humana, fazendo tudo sozinho.

O Exército enquanto isso, desenvolve novos sistemas de "apontar e disparar" para seus tanques e um sistema de mísseis chamado JAGM, Joint Air-to-Ground Missile. O JAGM tem a capacidade de escolher veículos para atingir sem intervenção humana. Em Março, o Pentágono solicitou fundos ao Congresso para construir 1051 JAGMs, num custo de 360 milhões de euros.

E a aviação? Os testes são todos focados no projeto “SkyBorg” (o nome já diz tudo): uma versão não tripulada do F-16 capaz de lutar sozinho.

Até ontem, os soldados que queriam causar uma explosão num local remoto tinham que decidir como e quando atacar: com um avião? Um míssil? Um barco? Um tanque? Eles então tiveram que direcionar a bomba, mirá-la e operar um comando.

Drones e sistemas como o Sea Mob estão isentando completamente os humanos de tais decisões. A única decisão que resta a um comando militar (mas não deve ser tomada antes e nem contra o consenso de todos) é quando os robôs ficam livres para matar violando as famosas leis de Asimov, talvez a partir dos momentos em que as comunicações de rádio são interrompidas durante uma operação de guerra.

Não é um assunto restrito apenas aos Estados Unidos

Desde os anos 90 Israel começou a projetar um sistema chamado HARPY, que hoje chamaríamos de inteligência artificial. O drone era capaz de sobrevoar áreas cobertas por radares e atacá-las de forma independente. A empresa então vendeu esse sistema para a China e outros países.

No início dos anos 2000,Inglaterra desenvolveu o míssil Brimstone, capaz de encontrar veículos inimigos no campo de batalha e “estabelecer” quais deles atingir.

No ano passado, 2018, o Presidente da Rússia Vladimir Putin falou de um drone subaquático equipado com armas nucleares, abrindo um cenário em que um dispositivo automático poderia ser equipado com a arma mais letal alguma vez criada pelo homem. E por outro lado, o próprio Putin admitiu que a nação é capaz de desenvolver a melhor IA “ela se tornará dona do mundo”.

La China não fez grandes declarações, mas o facto de estar na vanguarda da inteligência artificial ainda nos dá uma pausa para pensar. Estima-se que se tornará o país líder neste domínio nos próximos 10 anos, e poderá em breve explorar isto militarmente.

A guerra fria tecnológica

O receio de ser ultrapassado por países como a China ou a Rússia levou os EUA a gastarem fortemente no desenvolvimento da IA: 600 milhões de dólares em 2016, 800 em 2017 e mais de 900 este ano. O Pentágono não revelou detalhes sobre estes esforços, mas a partir de entrevistas oficiais é fácil deduzir que muitas soluções surgirão dos desenvolvimentos da investigação em IA. tecnologia militar, mesmo que não esteja imediatamente pronto para assumir o comando completamente.

No entanto, isso pode acontecer

O intenso investimento económico que os EUA estão a fazer para recuperar a certeza da supremacia tecnológica (e portanto militar) multiplica os riscos de forçar a mão das máquinas, ou deixá-las forçá-la. Robert Work diz claramente: “haverá um momento em que as máquinas vão 'cometer um erro' induzido por nós, porque não pretendemos ter a máquina perfeita, apenas a mais útil no menor tempo possível”.

A ideia de que as máquinas podem intervir completamente por conta própria para decidir matar seres humanos, violando as leis da robótica de Asimov, ainda pertence a uma imaginação que a rejeita totalmente: algo próximo de filmes apocalípticos como Terminator. Mas estas não são possibilidades distantes.

Em um planeta de nações cada vez mais competitivas nesse campo, a possibilidade de que máquinas autônomas possam causar danos aos adversários também em termos de vidas humanas é real. Não é bom dizer, menos ainda ouvir, mas é assim.