Se você sorrir para alguém e ela não responder, provavelmente vai achar isso desanimador. Não? Bem, este robô lhe daria mais satisfação do que algum vizinho.

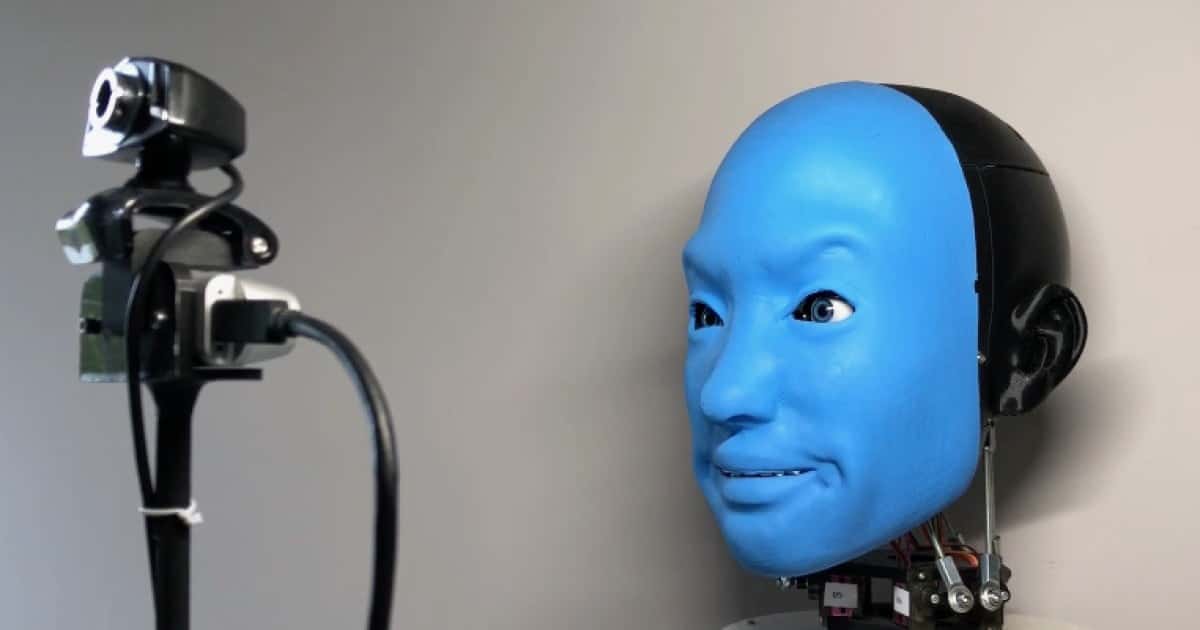

Desenvolvido por uma equipe de pesquisadores de engenharia da Universidade de Columbia na cidade de Nova York, o projeto EVA na verdade é um testa robótica humanóide. Ele é projetado para explorar a dinâmica das interações humano / robô por meio de expressões faciais. Consiste em um crânio adulto sintético impresso em 3D com uma superfície de borracha macia na frente.

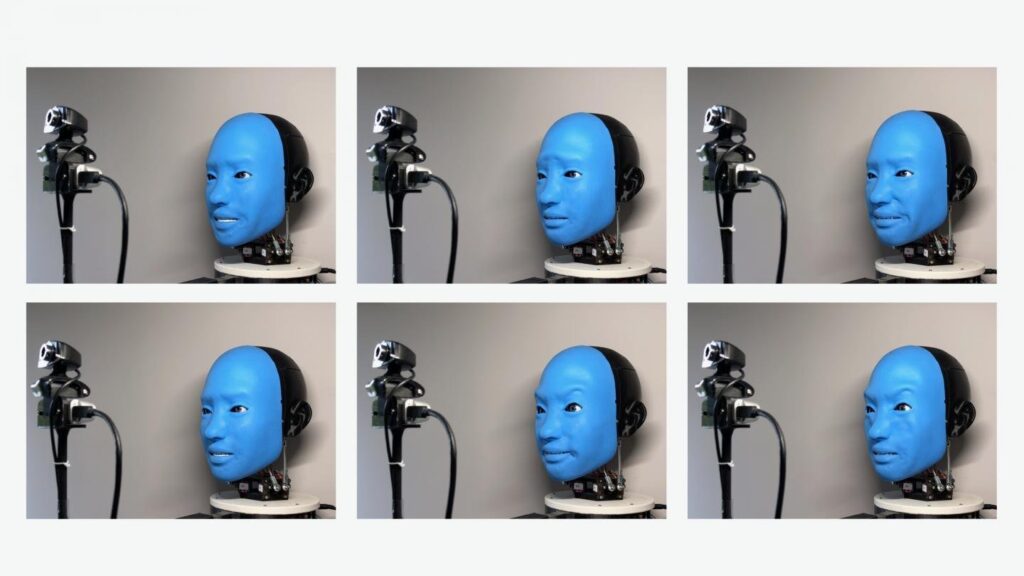

Os motores dentro do crânio puxam e liberam seletivamente cordões presos a vários locais da parte inferior da face, assim como os músculos sob a pele do rosto nos permitem mostrar diferentes expressões faciais. Por sua vez, EVA pode expressar emoções como raiva, nojo, medo, alegria, tristeza e surpresa, bem como “uma série de emoções mais matizadas”.

Um robô que imita nossas expressões faciais

Para desenvolver suas habilidades de imitar expressões faciais, os cientistas começaram a filmar o EVA enquanto ele movia seu rosto aleatoriamente. Quando o computador que controlava o robô analisou posteriormente as horas de filmagem, utilizou uma rede neural integrada para aprender quais combinações de “movimentos musculares” correspondiam às expressões faciais humanas.

Na segunda fase do "treinamento", quando uma câmera conectada capturou o rosto de uma pessoa interagindo com o robô, um seconda rede neural para identificar as expressões faciais daquele indivíduo e combiná-las visualmente com aquelas que o robô foi capaz de criar. O robô então assumiu esses “rostos” movendo seus músculos faciais artificiais.

É útil?

Embora os engenheiros admitam que simplesmente imitar as expressões faciais humanas pode ter aplicações limitadas, eles acreditam que ainda pode ser útil. Não é por acaso que tantos workshops estão trabalhando na reprodução de expressões faciais. Por exemplo, pode ajudar a aprimorar a maneira como interagimos com tecnologias assistivas.

“Há um limite para o quanto nós, humanos, podemos interagir emocionalmente com chatbots ou assistentes de voz baseados em nuvem”, diz o líder do projeto, Prof. Hod Lipson. “Nossos cérebros parecem responder bem a robôs que têm algum tipo de presença física reconhecível.”

Não me diga que a próxima geração do Google Nest ou Alexa será uma cabeça falando comigo, porque estou me despindo. Estou indo embora, hein?

Você pode ver o EVA imitando expressões faciais neste vídeo.