O que um rosto inexpressivo pode revelar sobre a sua orientação política? Muito mais do que você imagina, de acordo com um estudo recente que usou inteligência artificial para prever a orientação política a partir de fotos faciais. Mesmo controlando variáveis como idade, sexo e etnia, os algoritmos de reconhecimento facial foram capazes de adivinhar crenças políticas com precisão comparável à dos humanos. Mas quais são as implicações desta descoberta para a nossa privacidade na era digital?

Reconhecimento facial: o bom e o ruim

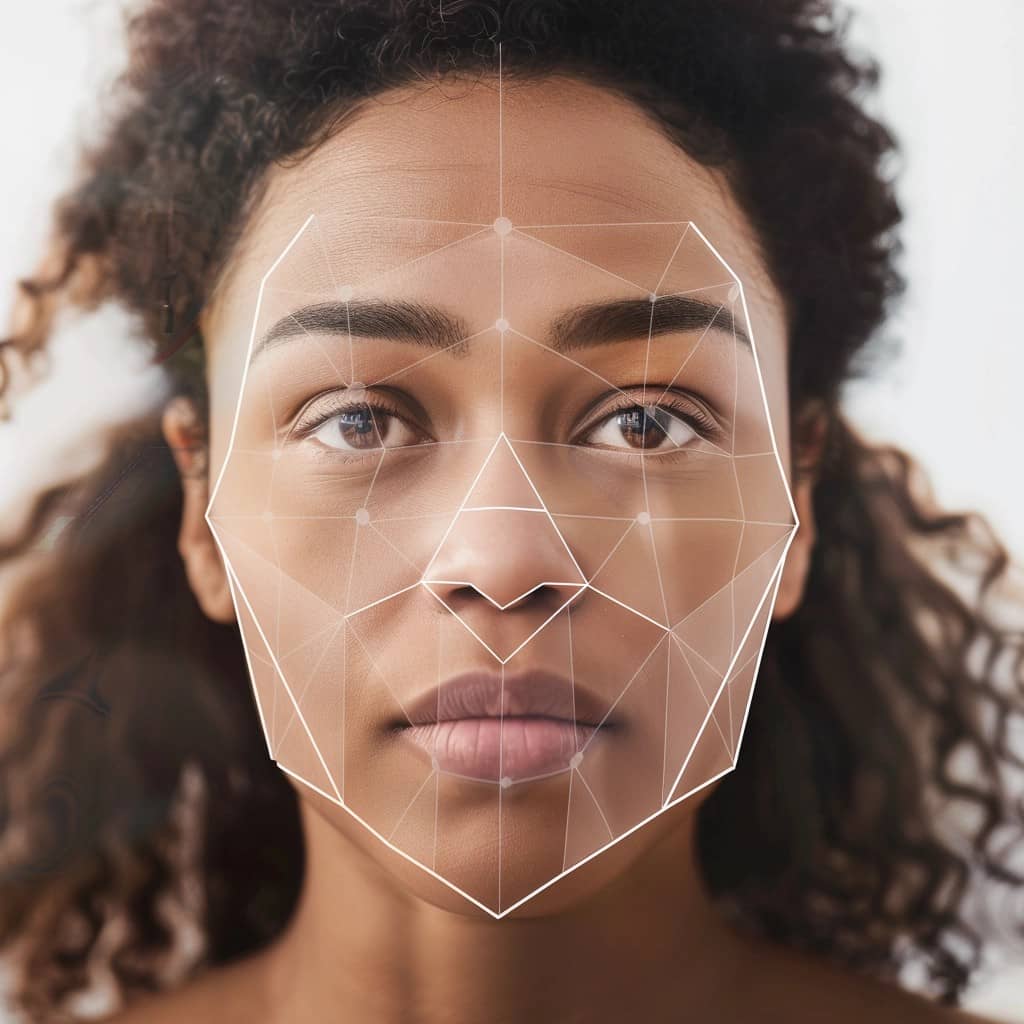

Il reconhecimento facial é uma forma de inteligência artificial que identifica e verifica indivíduos analisando padrões baseados em suas características faciais. Essencialmente, a tecnologia utiliza algoritmos para detectar rostos em imagens ou vídeos. Em seguida, meça vários aspectos do rosto, como a distância entre os olhos, o formato da mandíbula e o contorno das maçãs do rosto.

Essas medidas são transformadas em uma fórmula matemática, uma “assinatura facial”, que pode ser comparado com um banco de dados de rostos conhecidos para encontrar uma correspondência, ou usado em vários aplicativos, desde sistemas de segurança até desbloqueio de telefones e marcação de amigos nas redes sociais.

Com o uso crescente de tecnologias de reconhecimento facial nos setores público e privado, aumenta a possibilidade de que essas ferramentas sejam utilizadas para fins que vão além da simples identificação, como a previsão de atributos pessoais. Por exemplo, e é este o caso, a orientação política.

Prevendo a orientação política: o estudo

Em seu novo estudo publicado na revista Psicólogo americano (eu linko aqui), pesquisadores liderados por Michal Kosinski, professor associado de comportamento organizacional na Universidade de Stanford, seguiu um exemplo específico. O alvo? Isolar a influência apenas das características faciais na previsão da orientação política. O trabalho focou em variáveis como expressões e orientação da cabeça.

Para fazer isso, eles recrutaram 591 participantes de uma grande universidade privada e tiraram fotos em um ambiente altamente controlado. Todos os sujeitos usavam camisetas pretas, haviam removido a maquiagem e estavam com os cabelos puxados para trás. As fotos foram tiradas em posição fixa, em sala bem iluminada e contra fundo neutro.

As imagens foram então processadas por um algoritmo de reconhecimento facial, que extraiu “descritores faciais” numéricos. Esses descritores codificam características faciais em um formato analisável por computador. E foram usados para prever a orientação política dos participantes através de um modelo que os mapeou numa escala de orientação política.

A IA adivinha a orientação política melhor do que os humanos

Os resultados? Eles são incríveis. O algoritmo de reconhecimento facial foi capaz de prever a orientação política com um coeficiente de correlação de 0,22. Embora modesta, esta correlação é estatisticamente significativa e sugere que algumas características faciais estáveis podem estar ligadas à orientação política, independentemente de outros factores demográficos.

Mas isso não é tudo. Numa segunda etapa, os pesquisadores substituíram o algoritmo com 1.026 avaliadores humanos, pedindo-lhes que estimassem a orientação política a partir das mesmas imagens padronizadas. Surpreendentemente, os humanos também foram capazes de prever a orientação política com uma precisão comparável à do algoritmo. Com um coeficiente de correlação de 0,21. Um pouco menos bem, em suma.

Finalmente, numa terceira fase, os pesquisadores aplicaram o modelo a um conjunto de imagens de políticos, para validar os resultados em um cenário mais real. Mais uma vez, o modelo de reconhecimento facial foi capaz de prever a orientação política com uma precisão significativa. Demonstrando que algumas das características faciais preditivas também podem ser identificadas em imagens mais diversas.

Implicações futuras: uma ameaça sem precedentes

As descobertas deste estudo levantam preocupações significativas com a privacidade. O reconhecimento facial pode ser usado sem o consentimento ou conhecimento dos sujeitos.

As imagens faciais podem ser facilmente (e secretamente) obtidas pelas autoridades policiais ou obtidas de arquivos digitais ou tradicionais, incluindo redes sociais, plataformas de encontros, sites de partilha de fotos e bases de dados governamentais. Muitas vezes são facilmente acessíveis: as fotos de perfil do Facebook e do LinkedIn, por exemplo, podem ser visualizadas por qualquer pessoa sem o consentimento ou conhecimento da pessoa.

Portanto, as ameaças à privacidade representadas pela tecnologia de reconhecimento facial são, em muitos aspectos, sem precedentes. E com a utilização crescente destas ferramentas tanto no sector público como no privado, o risco de abuso e vigilância em massa torna-se cada vez mais real.

O futuro do reconhecimento facial: direitos de voto e direitos faciais

O estudo de Kosinsky e colegas abre uma janela para um futuro em que a tecnologia de reconhecimento facial poderá ser usada para revelar aspectos íntimos da nossa identidade, como a orientação política, sem o nosso consentimento ou conhecimento. Mas também levanta muitas questões e desafios éticos.

Como podemos equilibrar os benefícios potenciais desta tecnologia, como a melhoria da segurança ou a personalização de serviços, com os riscos para a privacidade e a liberdade individual? Como podemos garantir que estas ferramentas não sejam utilizadas para fins discriminatório ou opressivo, especialmente em relação às minorias e aos grupos vulneráveis?

Não há respostas fáceis para essas perguntas. Mas devemos procurá-los o mais rápido possível, porque o rosto que vemos no espelho todas as manhãs não é apenas um conjunto de características biométricas a serem analisadas e classificadas. É o reflexo da nossa humanidade, da nossa individualidade, da nossa liberdade de pensamento e expressão.

E esses são valores que nenhum algoritmo, por mais sofisticado que seja, jamais terá que controlar.