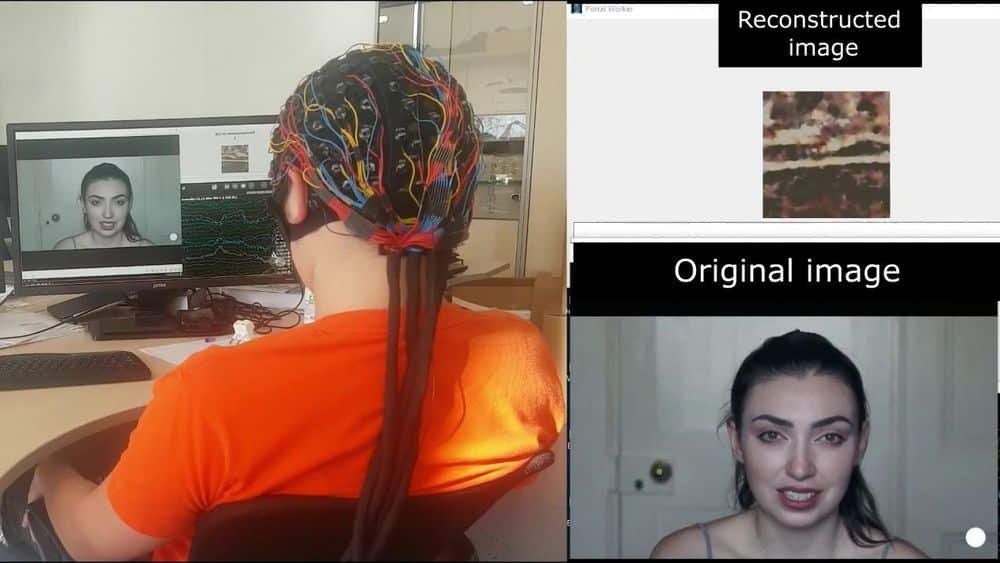

Uma equipe de pesquisa criou uma inteligência artificial que desenha em tempo real o que uma pessoa está vendo, simplesmente lendo e decodificando suas ondas cerebrais.

O mais importante é que é uma técnica não invasiva, capaz de coletar e codificar todas as informações sobre ondas cerebrais com um fone de ouvido conectado a uma eletroencefalografia (EEG).

“Os pesquisadores pensaram que estudar os processos cerebrais usando EEG era como tentar adivinhar a forma de uma pessoa analisando a fumaça do cigarro”, diz o pesquisador Grigori Rashkov em uma liberação. “Não esperávamos que contivesse informações suficientes para reconstruir, mesmo parcialmente, uma imagem vista por uma pessoa. No entanto, acabou por ser inteiramente possível. “

Pesquisa

A equipe conjunta formada por membros do Instituto de Física e Tecnologia de Moscou e da empresa russa Neurobotics iniciou seu estudo colocando um capacete especial com eletrodos, que pode registrar suas ondas cerebrais.

Na segunda fase, cada participante observou 20 minutos de fragmentos de vídeo com duração de 10 segundos cada, divididos em 5 categorias. Após as primeiras sessões, os pesquisadores já perceberam que podiam saber em qual categoria de vídeos os voluntários estavam assistindo, simplesmente observando seus dados de EEG.

Na terceira fase, os cientistas desenvolveram duas redes neurais: um treinado para gerar imagens em três categorias de vídeo e outro para transformar os dados de EEG em ruído comparável. Colocadas em competição, as duas redes GAN produziram imagens surpreendentes.

“Com a tecnologia atual, interfaces neurais invasivas como aqueles em desenvolvimento pela Neuralink, empresa de Elon Musk, deve enfrentar os desafios da cirurgia complexa e da rápida deterioração devido a processos naturais. Os sistemas podem oxidar e falhar em poucos meses”, dados Rachkov.

“Com este estudo pretendemos projetar interfaces neurais mais convenientes que não requerem implantes.”