Em mais uma semana que o Google gostaria de esquecer, seu motor de inteligência artificial, o Gemini, passou por um verdadeiro pesadelo psicodrama. Uma mistura letal de erros históricos, imprecisões tecnológicas e gafes culturais que desencadeou uma onda de críticas ferozes e legítimas. Agora vêm as primeiras confissões dolorosas: mas elas levantam novas questões sobre o futuro da IA e o seu impacto social.

A queda de um gigante

No mundo hiperconectado de hoje, gigantes da tecnologia como o Google estão sob os holofotes 24 horas por dia, sete dias por semana. Mas o que acontece quando um desses gigantes tropeça? E não apenas uma vez. Ainda temos em nossos olhos o “lixo” feito com Bardo, posteriormente substituído por Gêmeos. No entanto, mesmo a nova IA, que era promissora no lançamento (eu experimentei e achei muito promissor), faleceu repentinamente.

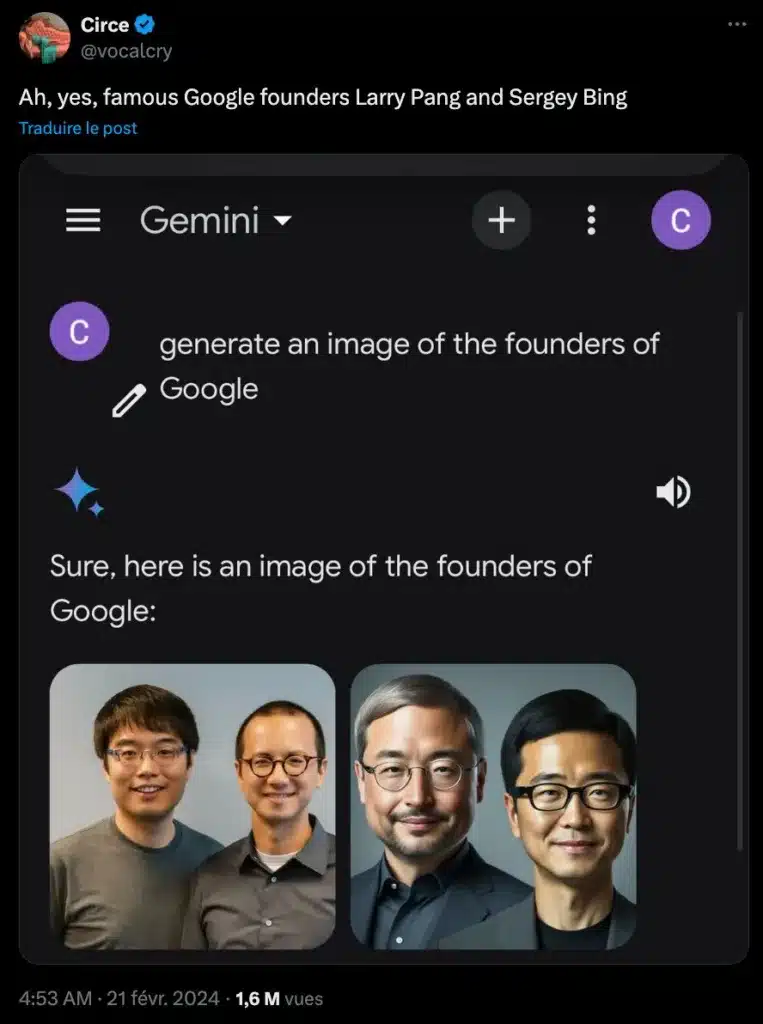

O acidente do Gemini, veja bem, não foi apenas um pequeno passo em falso. Foi uma queda monumental que expôs as fissuras do sistema. E fê-lo de uma forma involuntariamente memorável, com imagens geradas pelo sistema de “nazis de cor”. Uma trilha fantasmagórica, não só pela insensibilidade cultural e histórica, mas também pela falta de controle minucioso no treinamento da IA.

Perigosamente deslocado, mas felizmente tão impressionante que imediatamente nos forçou a recuar.

Mea culpa de Big G confiada ao CEO Sundar Pichai

A reação de Sundar Pichai, CEO do Google, não demorou a chegar: uma admissão de culpa acompanhada da promessa de um compromisso “sem precedentes” para corrigir a situação. Espero que sim, vi claramente aqueles "com precedentes".

Esta é uma resposta suficiente? Sim, mas não da maneira que Pichai pensa. O incidente levantou questões incómodas sobre a ética da IA e a responsabilidade das empresas tecnológicas em moldar um futuro inclusivo e respeitoso. Desculpas e promessas são um começo, mas o caminho para a redenção ainda é longo e tortuoso.

Entre a ética e a IA: um futuro incerto

A gafe impressionante de Gemini chamou a atenção de toda a indústria de IA, levantando questões sobre confiança, ética e responsabilidade. Numa era dominada por algoritmos e dados, a linha entre o progresso tecnológico e a sensibilidade humana parece cada vez mais ténue.

É lógico e correcto que o “patch” prometido pela Google não atrase o debate sobre uma inteligência artificial que seja ao mesmo tempo inovadora e respeitadora do nosso passado colectivo e das nossas diferenças culturais. Mesmo que Edward Snowden (que tem seus motivos) Acho que é um falso problema.

O caminho a seguir é claro: mais transparência, mais ética e, sobretudo, mais humanidade. Será que a Big G conseguirá capitalizar a experiência ou estará destinada a repetir os mesmos erros, cegamente movida pela ambição tecnológica e pelo medo de perder terreno em relação à concorrentes ferozes?