Nvidia, a gigante da GPU que conquistou o mundo da inteligência artificial, não dá sinais de desaceleração. Pelo contrário, com a apresentação do novo GPU Blackwell B200 e o "superchip" GB200 parecem pretender ampliar ainda mais a sua liderança sobre a concorrência.

Esses monstros de poder computacional, com até 30 vezes mais desempenho que o já impressionante H100, prometem redefinir os horizontes da IA e consolidar o domínio da Nvidia num setor cada vez mais estratégico e competitivo.

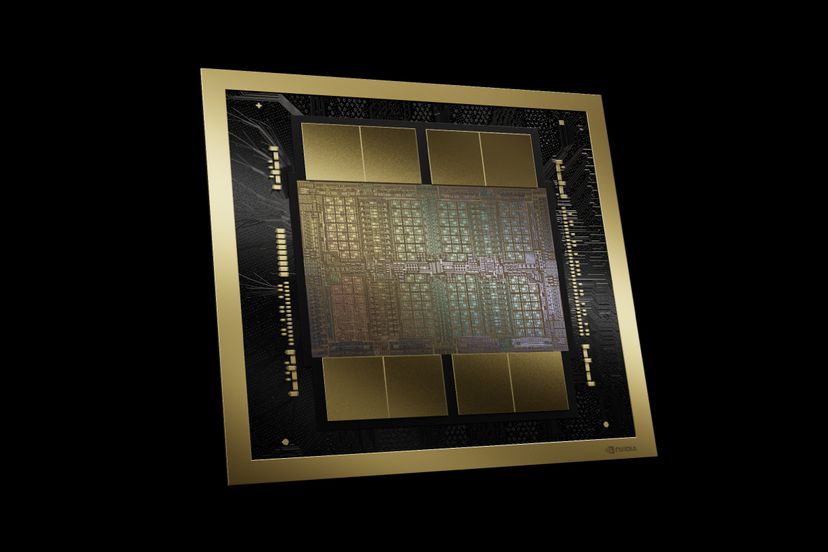

Blackwell B200, 208 bilhões de transistores e 20 petaflops de pura potência

Os números fazem sua cabeça girar. A nova GPU B200 contém impressionantes 208 bilhões de transistores (sim, você leu certo, bilhões) em um único chip, liberando até 20 petaflops de poder de computação de ponto flutuante de 4 bits (FP4). Para se ter uma ideia, este é um poder comparável ao de 20 milhões de laptops de última geração. E tudo isso em um único chip do tamanho de um cartão postal.

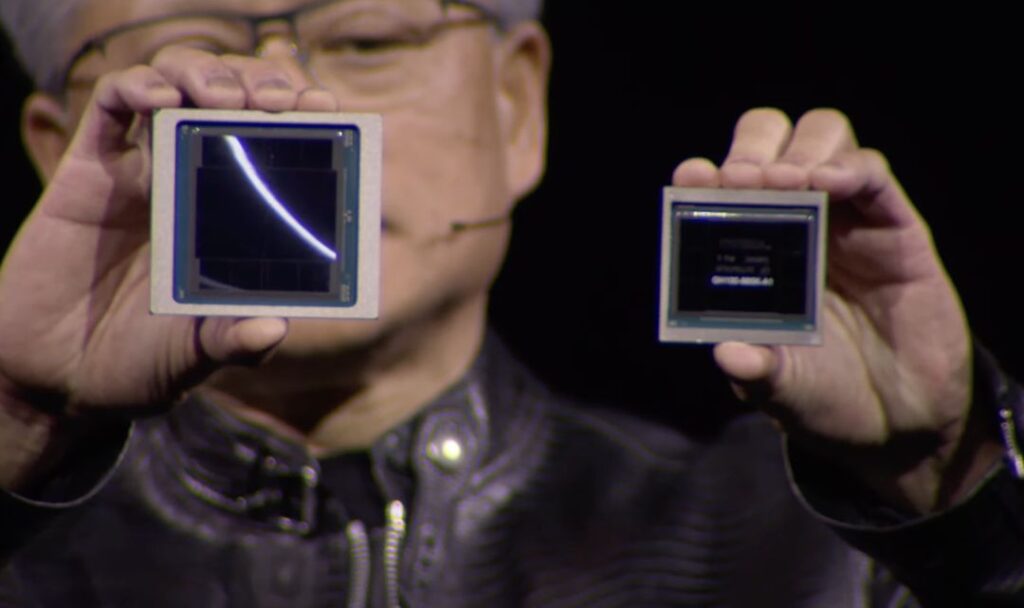

Mas o verdadeiro trunfo da Nvidia é o Blackwell GB200, um “superchip” que funde duas GPUs B200 com uma CPU Grace em um único pacote. Esta fera de 30 petaflops promete oferecer até 30x o desempenho do H100 em tarefas de inferência de modelo de linguagem grande (LLM), com uma redução de 25% no custo e no consumo de energia. Em duas palavras: mais energia, menos despesas, menos impacto ambiental. Sim, havia 7 palavras.

Quando um chip não é suficiente, o “motor transformador” cuida disso

Como a Nvidia traz todo esse poder? Um dos segredos está no “motor transformador” de segunda geração: uma arquitetura dedicada que duplica a capacidade computacional, colocando mais neurônios em menos espaço, para redes neurais cada vez maiores e de maior desempenho.

O que acontece quando você coloca dezenas ou centenas desses chips juntos em um servidor? Até 576 GPUs podem “conversar” entre si com uma largura de banda bidirecional de 1,8 terabytes por segundo. Em três palavras (desta vez de verdade, eu juro): computação paralela extrema.

Dos chips aos supercomputadores, é um passo curto

Se você quiser ter uma ideia do que veremos em breve, os sistemas que serão acionados por esses Blackwells serão capazes de treinar modelos com 27 trilhões de parâmetros. O GPT-4 possui “apenas” 1,7 trilhão.

A Nvidia parece estar lançando um desafio para todo o mundo da IA: você quer ir rápido? Siga-nos. E os grandes players da nuvem parecem ter compreendido a mensagem: Amazon, Google, Microsoft e Oracle já fizeram fila para oferecer essas bugigangas em seus serviços. Um sinal de que a fome por poder computacional está mais forte do que nunca.

Com a Blackwell, a Nvidia está matando o mercado?

Há quem torça o nariz a este poder excessivo da Nvidia, que corre o risco de criar um monopólio de facto num sector-chave como a inteligência artificial. É bom fazer a pergunta. Há quem tema que esta corrida para “maiores, mais rápidos e mais poderosos” possa levar a um desenvolvimento descontrolado de sistemas de IA cada vez mais complexos e imprevisíveis. Esta também é uma questão legítima.

Porque além desses pontos de interrogação, com Blackwell e GB200 a Nvidia demonstrou que está com o pé pressionado no acelerador da inovação. Ruim. E que não tenho intenção de removê-lo.

Goste ou não, o futuro da IA fala cada vez mais a linguagem das GPUs. E ele tem a cara astuta de Jensen Huang.