Na semana passada, abordamos a questão do pânico induzido pela mídia sobre inteligência artificial. Uma forma como qualquer outra, dizia-vos, de negar um debate saudável sobre as oportunidades e os riscos desta tecnologia que pode mudar completamente a nossa sociedade. Obviamente, existe também o outro lado da moeda: um grupo muito grande de cientistas que não estão nada preocupados com os possíveis perigos. Certo ou errado?

Porque há quem feche os olhos

“Você já pensou que a inteligência artificial poderia causar o fim da humanidade?”. Numa recente conferência de imprensa na Casa Branca, a porta-voz Karine Jean Pierre ele riu confrontado com esta questão. Pena que a resposta seja um sério “não”. Apesar dos pioneiros da IA, como Alan Turing já haviam alertado sobre os riscos de “as máquinas assumirem o controle”, muitos pesquisadores atuais parecem não se importar nem um pouco. No entanto, a IA está a progredir a taxas incríveis. Então, por que eles não discutem mais?

David Krueger, professor do Departamento de Engenharia da Universidade de Cambridge, afirma que os motivos são sobretudo culturais e históricos. Depois de várias fases em que foram colocadas expectativas excessivas e idealistas sobre estas tecnologias (utopia ou distopia), os investigadores decidiram passar à prática. Por esta razão, concentraram-se em áreas específicas, como a condução autónoma, parando para colocar questões sobre as implicações a longo prazo.

Eles se saíram bem ou mal? E se os riscos fossem reais?

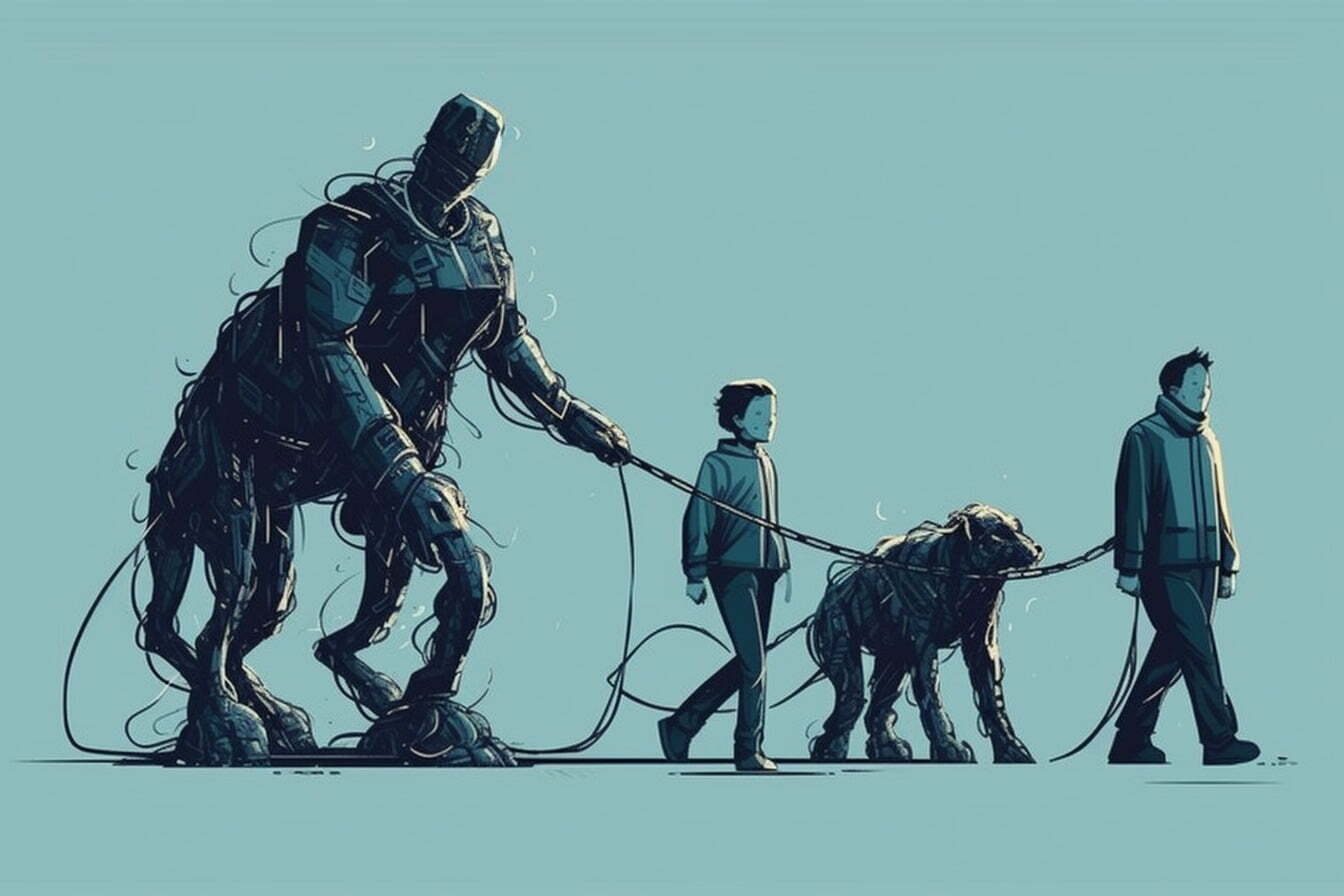

Um argumento básico dos “preocupados” (uma categoria muito diferente dos “catastrofistas”, veja bem) é a analogia entre IA e humanos. Tal como os humanos extinguiram outras espécies para competir por recursos, a inteligência artificial poderia fazer o mesmo connosco. Poderia nos substituir, em outras palavras. Economicamente e politicamente. Fisicamente.

São temas que parecem enormes, quase ficção científica. E, de facto, os riscos da IA são muitas vezes ignorados precisamente porque são considerados “não científicos”. Porém, isso não justifica a falta de atenção. Em vez disso, deveríamos abordar estes problemas como abordamos outras questões sociais complexas. E aqui entra em jogo um elemento crucial: o financiamento. A maioria dos investigadores em IA recebe financiamento de gigantes tecnológicos, criando possíveis conflitos de interesses que podem influenciar a forma como os especialistas abordam os problemas de IA, levando a uma negação dos riscos em vez de uma avaliação objectiva dos riscos.

Por isso, em vez de se “inclinar” para um dos dois pólos, no exercício que mais gostam aqueles que orientam as finanças e os meios de comunicação (dividir para conquistar), a opinião pública deveria olhar para a frente, ou melhor, para dentro. Dentro das coisas, exigindo que o tema seja explorado em profundidade.

É hora de levar a sério

Os riscos existenciais da IA podem ser mais especulativos do que reais quando comparados com questões prementes como preconceitos e notícias falsas, mas a solução básica é a mesma: regulamentação. É hora de iniciar um debate público robusto e abordar as questões éticas relacionadas à IA. Todo o resto é tédio, ou melhor, tédio.

Porque sabemos: não podemos ignorar os riscos potenciais da inteligência artificial para a humanidade. É essencial um debate público aberto e honesto, que tenha em conta os conflitos de interesses e as responsabilidades éticas. Só assim poderemos compreender se o riso de uma porta-voz da Casa Branca é verdadeiramente apropriado ou, pelo contrário, um sinal de perigosa (isto é) inconsciência colectiva.