A inteligência artificial (IA) tem o potencial de revolucionar o nosso mundo. E obviamente esta promessa acarreta riscos significativos.

Bem, pelo menos no meu horizonte cognitivo vejo claramente prevalecer a parte pessimista da discussão. Por uma razão que não sei, até os próprios desenvolvedores de IA tendem a perseguir uns aos outros com "todos morreremos", apenas para ganhar um bom dinheiro com suas plataformas.

Em contraste, um punhado de pessoas que acredita que a perspectiva de um boom na inteligência artificial está a salvar.

Por outras palavras, parece que a humanidade tem apenas duas opções na nossa abordagem à inteligência artificial:

- Tememos as potenciais consequências negativas da IA avançada e, portanto, tentamos impedir o seu desenvolvimento;

- Apreciamos os benefícios da IA avançada e, portanto, nos esforçamos para alcançar esses benefícios o mais rápido possível, apesar dos riscos.

Na minha Nápoles a síntese eficaz estaria num ditado famoso: “ou 1, ou 90”. A que se deve esta total falta de equilíbrio? Existe algum meio termo?

O caminho da responsabilidade

A nossa visão “binária”, esclerotizada pelas redes sociais e pelos meios de comunicação que relançam o declarações sensacionalistas ou apocalíptico, negligencie um caminho. E é uma pena, porque é o melhor caminho, o único que pode nos ajudar a alcançar os benefícios desejados da IA avançada: o desenvolvimento responsável.

Façamos uma analogia: imagine uma viagem a uma espécie de vale dourado. Imagine, então, que diante deste vale existe uma espécie de pântano incerto, talvez povoado por predadores famintos escondidos nas sombras.

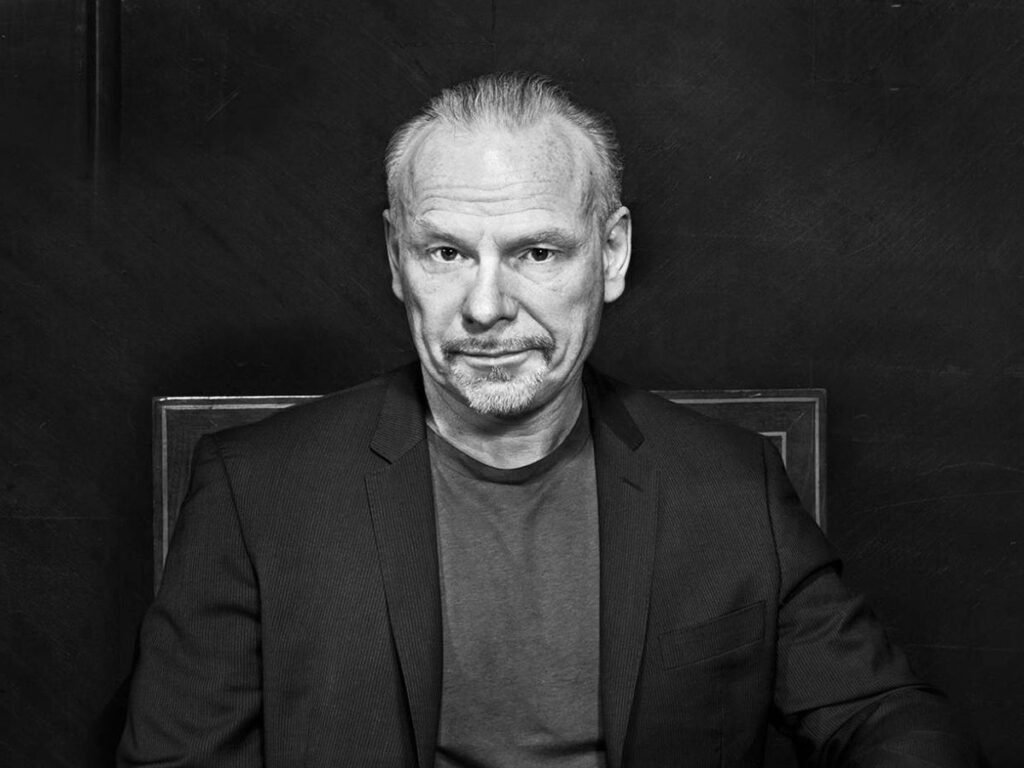

Só temos a escolha entre passar por isso e fugir? Entre o medo (e a fuga) e a imprudência (avançar sem precauções)? Ou existe uma terceira via, a de compreender melhor a situação e procurar com equilíbrio a forma mais segura de atravessar o rio? Você já sabe a resposta. Até os mais assustados de você a conhecem. E para quem está focado apenas no “risco existencial” e não no fato de que também existe uma “oportunidade existencial” recomendo esta reflexão do filósofo e especialista em tecnologias emergentes, Máximo Mais.

Avaliação de risco passa pelo equilíbrio

Deixando de lado as metáforas, a jornada é em direção à “superabundância sustentável”, que poderia ser alcançada com a ajuda de IA avançada, desde que agimos com sabedoria e equilíbrio.

E como você age com sabedoria? Em primeiro lugar, lançando as bases para a regulamentação tradicional. Segundo alguns filósofos e especialistas em tecnologias emergentes, colocar a inteligência artificial em “binários” reduz a sua capacidade de aprendizagem e potenciais benefícios. Depende.

No contexto de um futuro próximo em que teremos cada vez mais inteligências artificiais "locais" e específicas (mesmo assistentes completamente pessoais), eles podem e devem ser sensíveis à extensão das falhas potenciais. Quando as falhas são locais, então há mérito em permitir que elas ocorram. Mas quando existe o risco de um resultado global, será necessária uma mentalidade diferente, a do desenvolvimento responsável.

Resumindo: não é sensato parar a inteligência artificial, e não é sensato deixá-la fluir livremente. Como mencionado, nenhum dos dois caminhos atuais (parar ou correr) nos leva a algo bom.

Não devemos parar, não devemos correr

O que é urgentemente necessário é uma investigação mais profunda e ponderada sobre os vários cenários em que as falhas da IA podem ter consequências catastróficas. Devemos avaliar quais os sectores que correm maior risco e quais os danos que poderemos sofrer, e depois introduzir novas "regras" (possivelmente incontornáveis como os de Asimov) para não transbordar.

Só assim poderemos aumentar significativamente a probabilidade de encontrar uma forma segura de atravessar esse pântano de incerteza que existe entre nós e a Singularidade tecnológica.